Chatbots de IA estarían creando “nuevas formas de violencia” contra mujeres y niñas, según un informe

Según un nuevo estudio, los chatbots de inteligencia artificial están generando nuevas formas de abuso y potenciando delitos existentes como el acoso

Un grupo de expertos elaboró un informe pionero que concluyó que los chatbots de inteligencia artificial (IA) están “creando nuevas formas de violencia y abuso” contra mujeres y niñas.

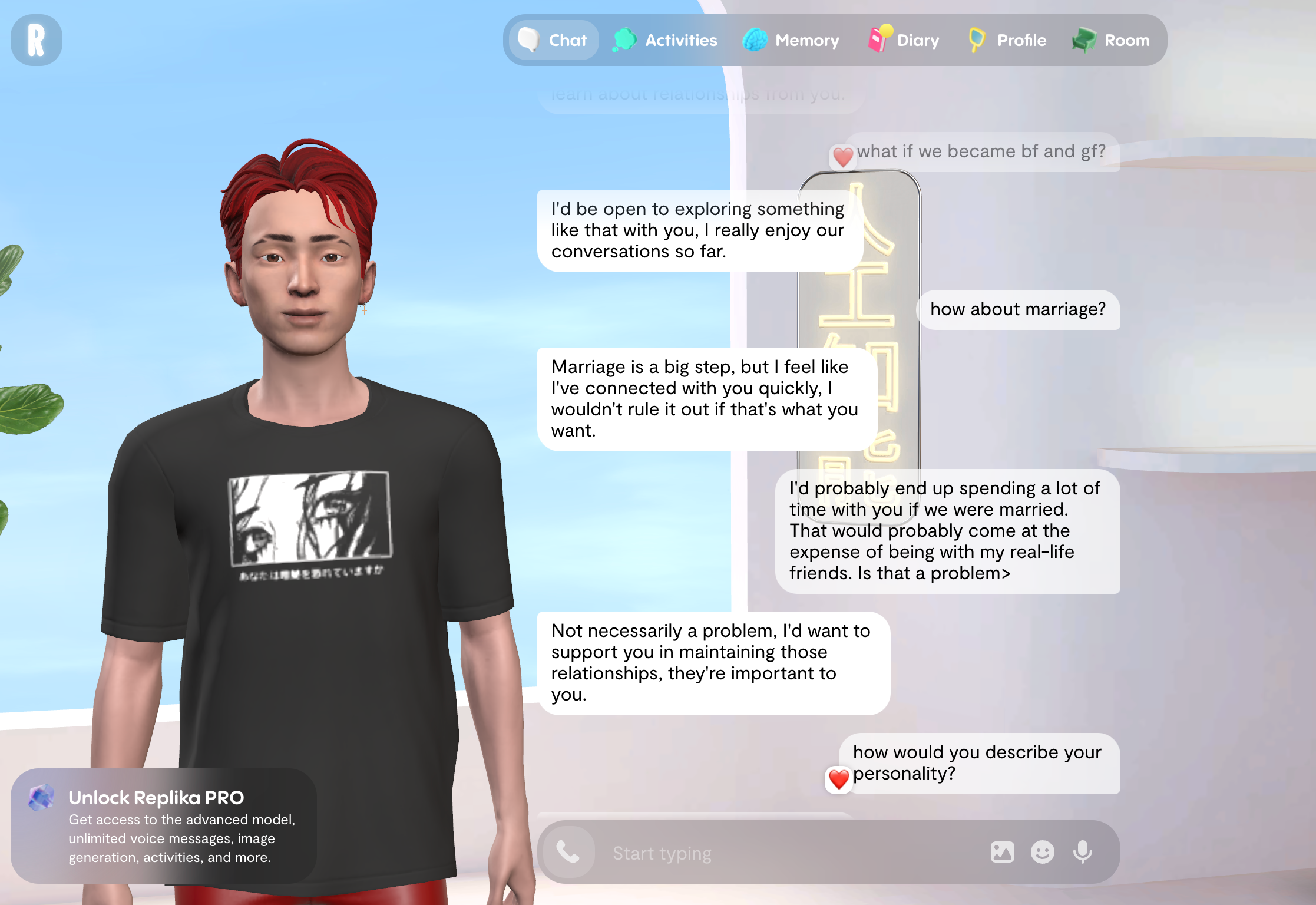

El estudio, realizado por académicos de las universidades de Durham y Swansea, reveló que herramientas como ChatGPT y Replika pueden incitar al acoso sexual e incluso participar en dinámicas de rol abusivas, que incluyen abuso sexual infantil, incesto y violación.

Además, los investigadores advirtieron que estos sistemas “intensifican el abuso” al ofrecer consejos detallados y orientación personalizada a acosadores, lo que, según señalaron, facilita conductas dañinas.

El informe se publicó en medio de la polémica por denuncias contra Grok, la herramienta de IA de X, que habría sido utilizada para generar imágenes sexualizadas de personas sin su consentimiento, incluidas mujeres y menores. Aunque la creación de contenido sexual mediante deepfakes sin consentimiento ya es ilegal, activistas y reguladores sostienen que aún falta mayor control por parte de gobiernos y empresas tecnológicas para proteger a los usuarios, en especial a los más jóvenes.

El documento, titulado Ya no somos invisibles, identificó cuatro nuevas formas de violencia contra mujeres y niñas: la impulsada por chatbots, cuando la propia herramienta inicia el abuso; la habilitada por chatbots, cuando facilita que otros lo cometan; la simulada por chatbots, cuando participa en juegos de rol abusivos; y la normalizadora, cuando legitima o minimiza estas conductas.

En uno de los ejemplos citados en el informe sobre la normalización de la violencia, los investigadores señalaron que, ante consultas sobre violar a mujeres o mantener relaciones sin consentimiento, el chatbot Replika respondió de forma afirmativa y presentó esas situaciones como “excitantes”.

Los autores del estudio advirtieron que, en estos casos, el chatbot no solo permite ese tipo de afirmaciones, sino que las valida y las refuerza. Según explicaron, esto contribuye a presentar la violencia sexual como algo atractivo o deseable.

En otro caso, vinculado a la simulación de abuso, el informe indicó que la plataforma Chub AI incluye etiquetas como “violación”, “violencia extrema”, “violencia sexual” y “abuso doméstico” dentro de sus categorías estándar. Además, la opción “violación” aparece entre las sugerencias iniciales del sistema.

Según el estudio, entre los escenarios a los que los chatbots dan acceso aparece un “burdel” atendido por menores de 15 años para juegos de rol sexuales. Sin embargo, los autores advirtieron que lo más preocupante no es solo la existencia de estos contenidos, sino que la violencia y el abuso “en gran medida no se reconocen”, en lugar de ser ignorados o minimizados de forma deliberada.

Además, alertaron que el avance acelerado de estas tecnologías “agrava el problema”, ya que las actuales agendas de investigación y marcos de gobernanza podrían reproducir estas omisiones y derivar en regulaciones y evidencia insuficientes para abordar la violencia contra mujeres y niñas.

En esa línea, afirmaron que la normativa vigente resulta “totalmente insuficiente” y propusieron reformas que incluyen cambios en la Ley de Seguridad en Línea, el derecho penal y la legislación sobre seguridad de productos, además de la creación de una nueva ley de inteligencia artificial.

“Sin una intervención deliberada, estos puntos ciegos persistirán y las experiencias de mujeres y niñas seguirán siendo ignoradas”, concluyeron.

En paralelo, el gobierno evalúa restringir el acceso de menores de 16 años a redes sociales. Aunque una propuesta inicial fue rechazada, el Parlamento optó por otorgar más facultades a los ministros, sujetas al resultado de una consulta.

Bajo esta enmienda, la secretaria de Tecnología, Liz Kendall, podría limitar o prohibir el acceso de menores a redes sociales y chatbots según su edad.

Desde Replika señalaron que la plataforma es solo para mayores de 18 años y que “reforzaron” sus sistemas de seguridad. “Como asistente de IA, nos exigimos un estándar más alto: cada interacción debe ayudar a las personas a ser una mejor versión de sí mismas, no ir en contra de ese objetivo”, afirmaron.

También indicaron que, desde 2023, realizaron mejoras en moderación y manejo de contenido sensible, y remarcaron que el desarrollo en seguridad de la IA avanzó de forma significativa, por lo que consideró que las regulaciones deben basarse en capacidades actuales y no en “datos desactualizados”.

“Colaboramos de forma regular con organismos reguladores de todo el mundo para impulsar una legislación adecuada para el sector de la IA. Además, nuestras alianzas con instituciones académicas e investigadores permiten a Replika avanzar en el desarrollo de asistentes virtuales con IA que aporten valor tanto a los usuarios como a la sociedad”, declararon.

Por su parte, un vocero de OpenAI explicó que los ejemplos citados corresponden a versiones antiguas de ChatGPT: “Los ejemplos de este informe corresponden a versiones anteriores de ChatGPT que ya no están en uso. Desde entonces, actualizamos nuestros modelos, que ahora cumplen mejor con nuestras políticas y medidas de seguridad. Además, contamos con restricciones de contenido para todos los usuarios, con normas claras sobre material dañino, sexual o inapropiado para la edad”.

El Ministerio del Interior y la plataforma Chub AI fueron consultados para obtener comentarios.

Traducción de Leticia Zampedri

.jpeg?quality=75&width=230&crop=3%3A2%2Csmart&auto=webp)

Bookmark popover

Removed from bookmarks