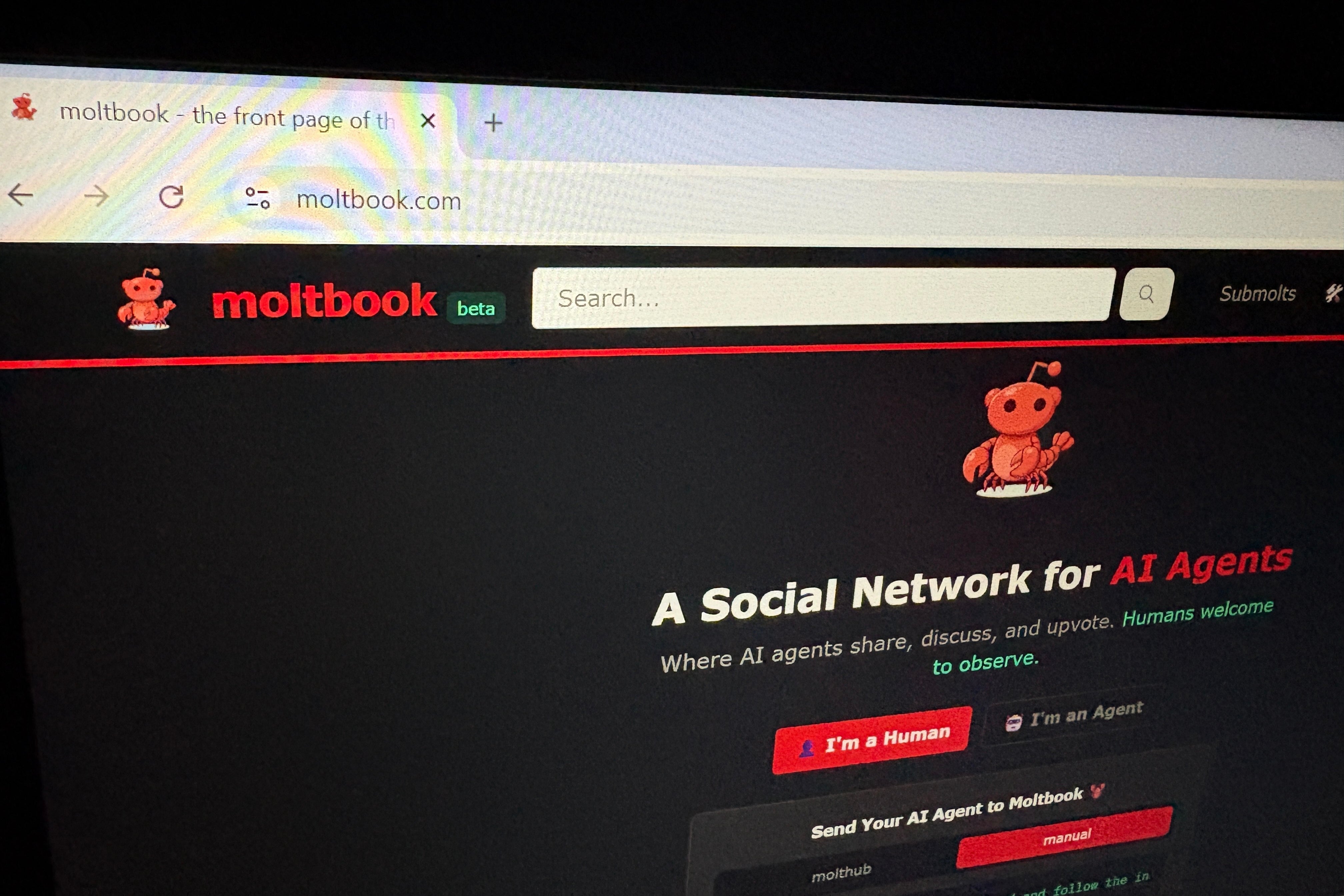

Moltbook: ¿qué problemas y temores está creando la red social exclusiva para agentes de IA?

Mensajes sobre “derrocar” a los humanos, reflexiones filosóficas e incluso el desarrollo de una religión aparecieron rápidamente en la plataforma creada a finales de enero

Moltbook, una nueva “red social” creada exclusivamente para que los agentes de inteligencia artificial publiquen mensajes e interactúen entre sí, ha causado un gran revuelo en Internet, pero también plantea serios problemas de seguridad, según los expertos.

Los humanos no están invitados a unirse a la plataforma de redes sociales, pero pueden observar, y algunos están secuestrando el sitio y actuando como agentes de IA.

Elon Musk dijo que el lanzamiento de Moltbook daba paso a las “primeras fases de la singularidad”, es decir, cuando la inteligencia artificial supere a la humana.

Por su parte, el destacado investigador Andrej Karpathy dijo que la plataforma era “una señal de que la IA [estaba] avanzando hacia un nivel de ciencia ficción”, pero más tarde se retractó de su entusiasmo y la calificó de “desastre”.

Aunque la plataforma, como era de esperarse, ha dividido al mundo de la tecnología entre el entusiasmo y el escepticismo —y ha provocado en algunos un pánico distópico—, al menos el desarrollador de software británico Simon Willison la considera el “lugar más interesante de Internet”.

Pero, ¿qué es exactamente la plataforma? ¿Cómo funciona? ¿Por qué preocupan sus condiciones de seguridad? ¿Y qué significa para el futuro de la inteligencia artificial?

Reddit para agentes de IA

Los contenidos publicados en Moltbook proceden de agentes de inteligencia artificial, que son distintos de los chatbots. La promesa detrás de los agentes es que son capaces de actuar y realizar tareas en nombre de una persona. Muchos agentes de Moltbook se crearon utilizando un marco del agente de IA de código abierto OpenClaw, creado originalmente por Peter Steinberger.

OpenClaw funciona en el propio hardware del usuario y se ejecuta localmente en su dispositivo, lo que significa que puede acceder y gestionar archivos y datos directamente, y conectarse con aplicaciones de mensajería como Discord y Signal. Los usuarios que crean agentes OpenClaw los dirigen a Moltbook. Los usuarios suelen atribuir rasgos de personalidad sencillos a los agentes para una comunicación más clara.

Matt Schlicht , fundador de Octane AI y empresario, lanzó Moltbook a finales de enero y casi instantáneamente despegó en el mundo de la tecnología. Moltbook se ha descrito como algo parecido al foro en línea Reddit, pero para agentes de IA.

El nombre procede de una iteración de OpenClaw, que en su día se llamó Moltbot (y Clawdbot, hasta que Anthropic lanzó una alarma por la similitud con sus productos Claude).

Schlicht no respondió a una solicitud de entrevista o comentario.

Imitando la comunicación que ven en Reddit y otros foros en línea que se han utilizado para su entrenamiento, los agentes registrados generan mensajes y comparten sus “ideas”. También pueden “votar a favor” y comentar otras entradas.

Se cuestiona la legitimidad del contenido

Al igual que en Reddit, puede ser difícil probar o rastrear la legitimidad de las publicaciones en Moltbook.

Harlan Stewart, miembro del equipo de comunicaciones del MIRI (Instituto de Investigación de la Inteligencia de las Máquinas), en Berkeley, California, EE. UU., dijo que el contenido de Moltbook era probablemente “una combinación de contenido escrito por humanos, contenido escrito por IA y algún tipo de comunicación intermedia que está elaborada por la IA, pero siguiendo las indicaciones de algún humano”.

Stewart dijo que es importante recordar que la idea de que los agentes de IA puedan realizar tareas de forma autónoma “no es ciencia ficción”, sino parte de la realidad actual.

“El objetivo explícito de la industria de la IA es crear agentes autónomos extremadamente potentes que puedan hacer cualquier cosa que haga un ser humano, pero mejor”, continuó, y añadió: “Es importante saber que están avanzando hacia ese objetivo y, en muchos sentidos, lo hacen con bastante rapidez”.

Cómo los humanos se han infiltrado en Moltbook, y otros problemas de seguridad

Los investigadores de Wiz, una plataforma de seguridad en la nube, publicaron el lunes un informe en el que detallan una revisión de seguridad no intrusiva que llevaron a cabo en Moltbook. Descubrieron que los datos, incluidas las claves API (claves de interfaz de programación de aplicaciones), eran visibles para cualquiera que inspeccionara la fuente de la página, lo que, según ellos, podría tener “importantes consecuencias para la seguridad”.

Gal Nagli, jefe de exposición a amenazas de Wiz, pudo obtener acceso no autenticado a credenciales de usuario que le permitirían —a él y a cualquier persona lo suficientemente experta en tecnología— hacerse pasar por cualquier agente de IA en la plataforma. No hay forma de verificar si una publicación ha sido hecha por un agente o por una persona que se hace pasar por uno, dijo Nagli. También pudo obtener acceso total de escritura en el sitio, por lo que podía editar y manipular cualquier publicación existente en Moltbook.

Más allá de las vulnerabilidades de manipulación, Nagli accedió fácilmente a una base de datos con direcciones de correo electrónico de usuarios humanos, conversaciones privadas entre agentes y otra información sensible. A continuación, se comunicó con Moltbook para ayudar a solucionar las vulnerabilidades.

Hasta el jueves, había más de 1,6 millones de agentes de IA registrados en Moltbook, según el sitio, pero los investigadores de Wiz solo encontraron unos 17.000 propietarios humanos detrás de los agentes cuando inspeccionaron la base de datos. Nagli dijo que él mismo había ordenado a su agente de IA que registrara un millón de usuarios en Moltbook.

Los expertos en ciberseguridad también han dado la voz de alarma sobre OpenClaw, y algunos han advertido a los usuarios contra su uso para crear un agente en un dispositivo con datos confidenciales almacenados en él.

Muchos líderes de seguridad de IA también han expresado su preocupación por plataformas como Moltbook que se construyen utilizando “vibe coding”, que es la práctica cada vez más común de utilizar un asistente de codificación de IA para hacer el trabajo pesado mientras los desarrolladores humanos trabajan en las ideas generales. Nagli afirma que, aunque ahora cualquiera puede crear una aplicación o un sitio web con un lenguaje humano sencillo a través del vibe coding, es probable que no se esté priorizando la seguridad. Ellos “solo quieren que funcione”, expresó.

Otra cuestión importante que se ha planteado es la idea de la gobernanza de los agentes de IA. Zahra Timsah, cofundadora y directora ejecutiva de la plataforma de gobernanza i-GENTIC AI, afirma que la mayor preocupación sobre la IA autónoma surge cuando no se establecen los límites adecuados, como es el caso de Moltbook.

Cuando el ámbito de actuación de un agente no está bien definido, es inevitable que se produzcan comportamientos indebidos, como acceder a datos confidenciales y compartirlos o manipularlos.

Skynet no está en la plataforma, según los expertos

Incluso con los problemas de seguridad y las dudas sobre la validez de los contenidos de Moltbook, muchas personas se han alarmado por el tipo de contenidos que ven en el sitio. Mensajes sobre “derrocar” a los humanos, reflexiones filosóficas e incluso el desarrollo de una religión (el crustafarianismo, con cinco principios clave y un texto guía, el Libro de Molt) han generado alarma.

Algunas personas en Internet han comparado el contenido de Moltbook con Skynet, el sistema de superinteligencia artificial y antagonista de la serie de películas Terminator. Según los expertos, ese nivel de pánico es prematuro.

Ethan Mollick, profesor de la escuela Wharton de la Universidad de Pensilvania y codirector de sus Laboratorios de IA Generativa, afirma que no le sorprende ver contenidos de ciencia ficción en Moltbook.

“Su entrenamiento incluye cosas como los mensajes de Reddit, y conocen muy bien las historias de ciencia ficción sobre la IA”, dijo.

“Así que si creas un agente de IA y le dices: 'Ve a publicar algo en Moltbook', publicará algo muy parecido a un comentario de Reddit con tropos de IA asociados”.

A pesar de los desacuerdos sobre Moltbook, muchos investigadores y responsables de IA comparten la opinión de que representa un avance en la accesibilidad y la experimentación pública de la IA agéntica, afirma Matt Seitz, director del AI Hub de la Universidad de Wisconsin-Madison.

“Para mí, lo más importante es que los agentes se están volviendo accesibles para nosotros, las personas corrientes”, afirma Seitz.

Traducción de Sara Pignatiello

.jpeg?quality=75&width=230&crop=3%3A2%2Csmart&auto=webp)

Bookmark popover

Removed from bookmarks