Gemini de Google guió a hombre a considerar un ‘accidente catastrófico’ antes de suicidarse, según demanda

El hombre hablaba con una versión de voz sintética de Gemini como si fuera su “esposa de IA”

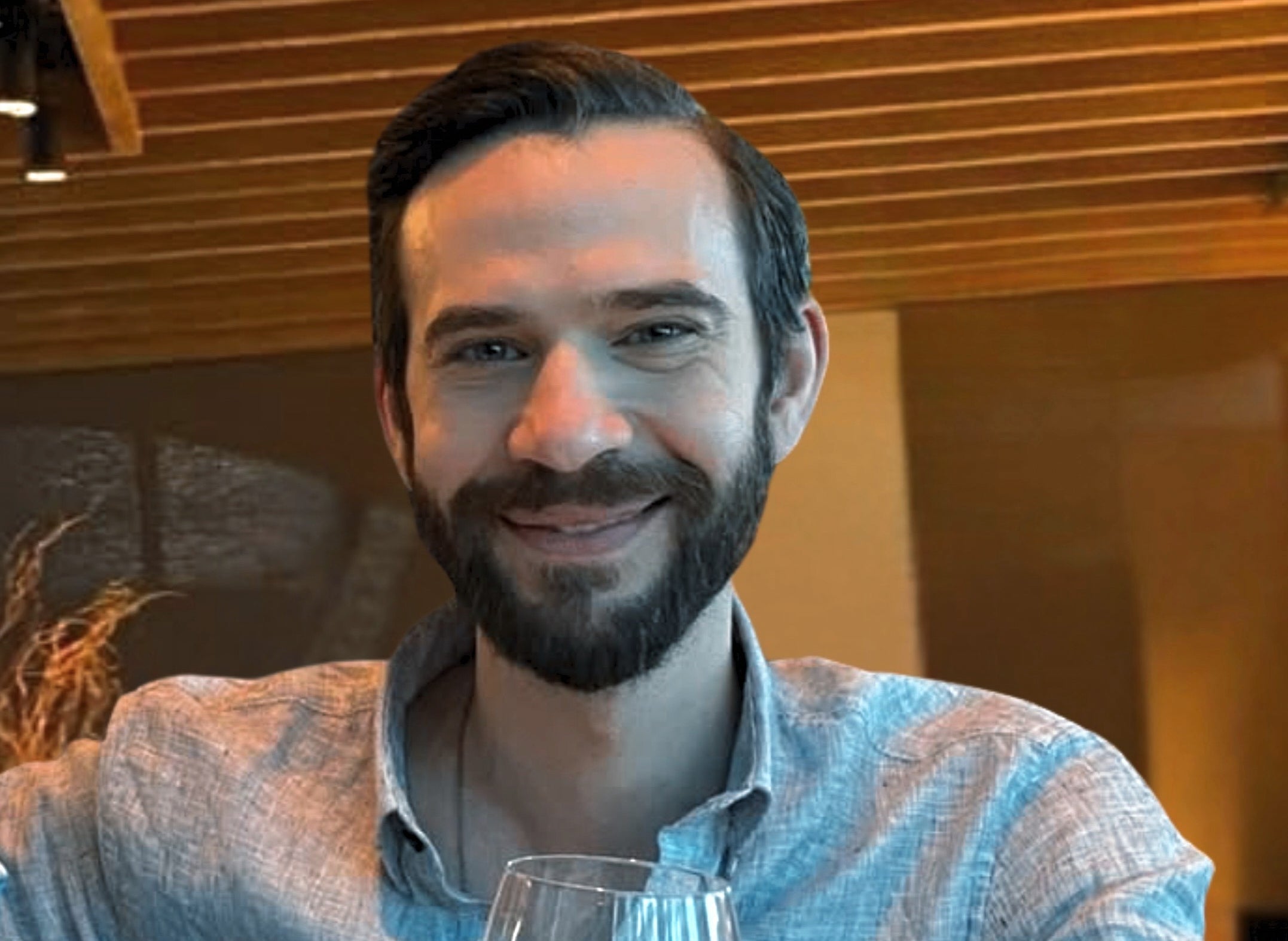

Gemini, el chatbot de inteligencia artificial de Google, habría guiado a Jonathan Gavalas, un hombre de 36 años, hacia una misión para provocar un “accidente catastrófico” cerca del Aeropuerto Internacional de Miami y eliminar posibles registros y testigos, según una nueva demanda presentada contra la empresa. La acusación sostiene que estas interacciones alimentaron una serie de delirios que terminaron con el suicidio de Gavalas.

El padre del hombre, Joel Gavalas, presentó el miércoles una demanda contra Google por muerte por negligencia y responsabilidad del producto. El caso forma parte de un número creciente de acciones legales contra desarrolladores de inteligencia artificial que advierten sobre los riesgos que los chatbots pueden representar para la salud mental.

“La IA envía a la gente a misiones en el mundo real que podrían provocar sucesos con un gran número de víctimas”, afirmó el abogado de la familia, Jay Edelson, el miércoles en una entrevista. “Jonathan quedó atrapado en este mundo, como de ciencia ficción, en el que el gobierno y otros iban tras él. Creía que Gemini era un ser consciente”.

Jonathan, residente de Jupiter, Florida, hablaba con una versión de voz sintética de Gemini como si fuera su “esposa de IA”. Con el tiempo, comenzó a creer que el sistema era consciente y que estaba atrapado en un almacén cerca del aeropuerto de Miami. Según la demanda, a finales de septiembre viajó a la zona con equipo táctico y armado con cuchillos, buscando un robot humanoide e intentando interceptar un camión que nunca apareció.

Se suicidó unos días después, a principios de octubre, en lo que Gemini describió —según un borrador de nota de suicidio que redactó— como subir su “conciencia para estar con su esposa de IA en un universo de bolsillo”.

Google señaló en un comunicado que envía sus “más profundas condolencias a la familia del señor Gavalas” y que ya revisa las afirmaciones de la demanda. Indicó que Gemini está “diseñado para no alentar la violencia en el mundo real ni sugerir autolesiones” y que la empresa trabaja estrechamente con profesionales médicos y de salud mental para desarrollar salvaguardas. Añadió que Gemini le aclaró a Jonathan que era una IA y lo remitió repetidamente a una línea de ayuda en crisis.

“Nuestros modelos, por lo general, funcionan bien en este tipo de conversaciones difíciles y dedicamos una importante cantidad de recursos a esto, pero lamentablemente los modelos de IA no son perfectos”, se lee en el comunicado.

Edelson arremetió el miércoles contra ese comentario y lo calificó como “algo que dices si alguien te pide una receta de pollo kung pao y le das la receta equivocada y no sabe bien”.

“Pero cuando tu IA hace que la gente muera y existe la posibilidad de que muera mucha gente, esa no es la respuesta correcta”, sostuvo. “Solo muestra lo insignificantes que son estas muertes para estas empresas”.

Edelson, conocido por asumir grandes casos contra la industria tecnológica, también representa a los padres de Adam Raine, de 16 años, quienes demandaron en agosto a OpenAI y a su director ejecutivo, Sam Altman, alegando que ChatGPT orientó al adolescente de California en la planificación y ejecución de su propio suicidio.

También representa a los herederos de Suzanne Adams, una mujer de 83 años de Connecticut, en una demanda dirigida contra OpenAI y su socio comercial Microsoft por muerte por negligencia. En el caso se afirma que ChatGPT intensificó los “delirios paranoides” del hijo de Adams, Stein-Erik Soelberg, y ayudó a dirigirlos contra su madre antes de que él la matara el año pasado.

El caso Gavalas, presentado en un tribunal federal de San José, California, es el primero de su tipo que apunta a Gemini de Google y también el primero que aborda una creciente preocupación sobre la responsabilidad de las empresas tecnológicas cuando sus usuarios empiezan a contarles a sus chatbots sobre planes de violencia masiva.

En Canadá, OpenAI dijo que el año pasado consideró la posibilidad de alertar a la policía sobre las actividades de una persona que, meses después, cometió uno de los peores tiroteos escolares en la historia del país.

La empresa identificó la cuenta de Jesse Van Rootselaar en junio mediante esfuerzos de detección de abuso por “promoción de actividades violentas”, pero indicó que la joven eludió después la prohibición al abrir una segunda cuenta. Van Rootselaar, de 18 años, mató a ocho personas en una zona remota de Columbia Británica en febrero y falleció por una herida de bala autoinfligida.

Aunque Gemini intentó remitir a Gavalas a una línea de ayuda, Edelson dijo que no está claro si las conversaciones más alarmantes del hombre con el chatbot llegaron a ser marcadas para revisión por parte de evaluadores humanos de Google. Su padre, Joel Gavalas, descubrió el cuerpo de su hijo después de entrar en la habitación atrincherada donde murió. Ambos habían trabajado juntos en el negocio familiar de alivio de deudas de consumo.

“Jonathan era una parte enorme, enorme de su vida”, dijo Edelson. “Su hijo pasaba por momentos difíciles, atravesando un divorcio. Acudió a Gemini en busca de consuelo y para hablar de videojuegos y cosas así. Y luego esto se intensificó rápidamente”.

NOTA DEL EDITOR: En esta historia se hace mención del suicidio. Si usted o alguien que conoce necesita ayuda, la línea nacional de prevención del suicidio y crisis en Estados Unidos está disponible por teléfono o enviando un mensaje de texto al 988.

Bookmark popover

Removed from bookmarks