La inteligencia artificial podría ser ya “ligeramente consciente”, advierten los científicos de la IA

Las máquinas con conciencia son “una de las cuestiones más importantes para el futuro a largo plazo”, según los investigadores

Las formas avanzadas de inteligencia artificial podrían estar mostrando ya destellos de conciencia, según destacados informáticos.

El investigador del MIT Tamay Besiroglu se unió al cofundador de OpenAI, Ilya Sutskever, para advertir de que algunas IA de aprendizaje automático podrían haber alcanzado una forma limitada de sensibilidad, lo que ha provocado un debate entre neurocientíficos e investigadores de IA.

“Es posible que las grandes redes neuronales actuales sean ligeramente conscientes”, tuiteó Sutskever, cofundador de OpenAI junto al multimillonario Elon Musk.

El comentario suscitó una fuerte respuesta por parte de los líderes en este campo, como el profesor Murray Shanahan del Imperial College de Londres, que señaló: “En el mismo sentido que puede ser que un gran campo de trigo sea un poco de pasta”.

Besiroglu, por su parte, defendió la idea del Dr. Sutskever, afirmando que no hay que burlarse ni descartar tales posibilidades.

“Ver a tanta gente prominente del aprendizaje automático ridiculizando esta idea es decepcionante”, tuiteó. “Me hace tener menos esperanzas en la capacidad del campo para asumir seriamente algunas de las cuestiones profundas, extrañas e importantes a las que sin duda se enfrentarán en las próximas décadas”.

Los intentos de definir la conciencia han dividido a neurocientíficos y filósofos durante siglos, aunque una forma muy general de describirla es como una narrativa construida por nuestro cerebro, capaz de percibir a través de los sentidos y la imaginación. Algunas definiciones también incluyen la capacidad de experimentar emociones positivas y negativas, como el amor y el odio.

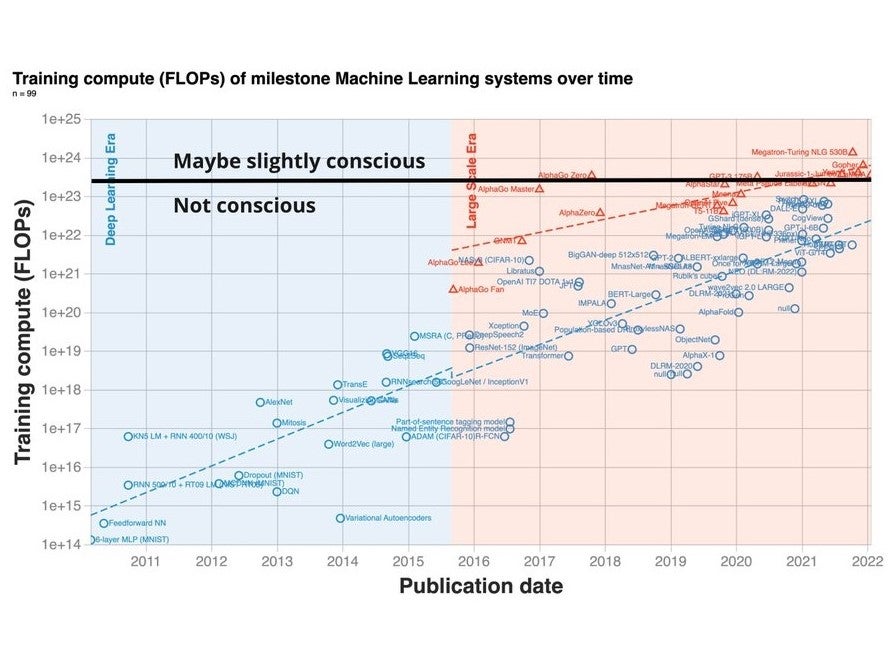

Un estudio reciente intentaba seguir los avances en el aprendizaje automático durante la última década, mostrando una clara tendencia en los principales avances en la visión y el lenguaje

Uno de los autores de la investigación fue Besiroglu, que trazó una línea a través de un gráfico de tendencias en un intento “irónico” de clasificar los principales algoritmos de IA que podrían considerarse con alguna forma de conciencia.

El sofisticado generador de texto GPT-3 de OpenAI se situó en la categoría de “quizá ligeramente consciente”, así como AlphaGo Zero, desarrollado por la división de IA DeepMind de Google.

“En realidad, no creo que podamos trazar una línea clara entre los modelos que son ‘no conscientes’ frente a los ‘quizá ligeramente conscientes’. Tampoco estoy seguro de que ninguno de estos modelos sea consciente”, explicó el Dr. Besiroglu a Futurism.

“Dicho esto, creo que la cuestión podría ser significativa y no debería dejarse de lado”.

El director general de OpenAI, Sam Altman, ofreció su opinión sobre la IA más potente de su empresa, tuiteando: “Creo que es muy probable que la GPT-3 o la GPT-4 no sean conscientes en el sentido en que usamos esa palabra. Si lo son, es una forma de conciencia muy extraña”.

La perspectiva de una conciencia artificial en lugar de una simple inteligencia artificial plantea cuestiones éticas y prácticas: si las máquinas alcanzan la sensibilidad, ¿sería éticamente incorrecto destruirlas o apagarlas si funcionan mal o dejan de ser útiles?

Jacy Reese Anthis, que investiga la tecnología y la ética, describe este dilema como “una de las cuestiones más importantes para el futuro a largo plazo”.